Merge branch 'jackfrued:master' into master

|

|

@ -10,7 +10,7 @@

|

|||

4. 2000年10月16日:Python 2.0发布,增加了完整的[垃圾回收](https://zh.wikipedia.org/wiki/%E5%9E%83%E5%9C%BE%E5%9B%9E%E6%94%B6_(%E8%A8%88%E7%AE%97%E6%A9%9F%E7%A7%91%E5%AD%B8)),提供了对[Unicode](https://zh.wikipedia.org/wiki/Unicode)的支持。与此同时,Python的整个开发过程更加透明,社区对开发进度的影响逐渐扩大,生态圈开始慢慢形成。

|

||||

5. 2008年12月3日:Python 3.0发布,它并不完全兼容之前的Python代码,不过因为目前还有不少公司在项目和运维中使用Python 2.x版本,所以Python 3.x的很多新特性后来也被移植到Python 2.6/2.7版本中。

|

||||

|

||||

目前我们使用的Python 3.7.x的版本是在2018年发布的,Python的版本号分为三段,形如A.B.C。其中A表示大版本号,一般当整体重写,或出现不向后兼容的改变时,增加A;B表示功能更新,出现新功能时增加B;C表示小的改动(例如:修复了某个Bug),只要有修改就增加C。如果对Python的历史感兴趣,可以阅读名为[《Python简史》](http://www.cnblogs.com/vamei/archive/2013/02/06/2892628.html)的网络文章。

|

||||

目前我使用的Python 3.7.x的版本是在2018年发布的,Python的版本号分为三段,形如A.B.C。其中A表示大版本号,一般当整体重写,或出现不向后兼容的改变时,增加A;B表示功能更新,出现新功能时增加B;C表示小的改动(例如:修复了某个Bug),只要有修改就增加C。如果对Python的历史感兴趣,可以阅读名为[《Python简史》](http://www.cnblogs.com/vamei/archive/2013/02/06/2892628.html)的网络文章。

|

||||

|

||||

#### Python的优缺点

|

||||

|

||||

|

|

@ -218,7 +218,7 @@ pip3 install ipython

|

|||

|

||||

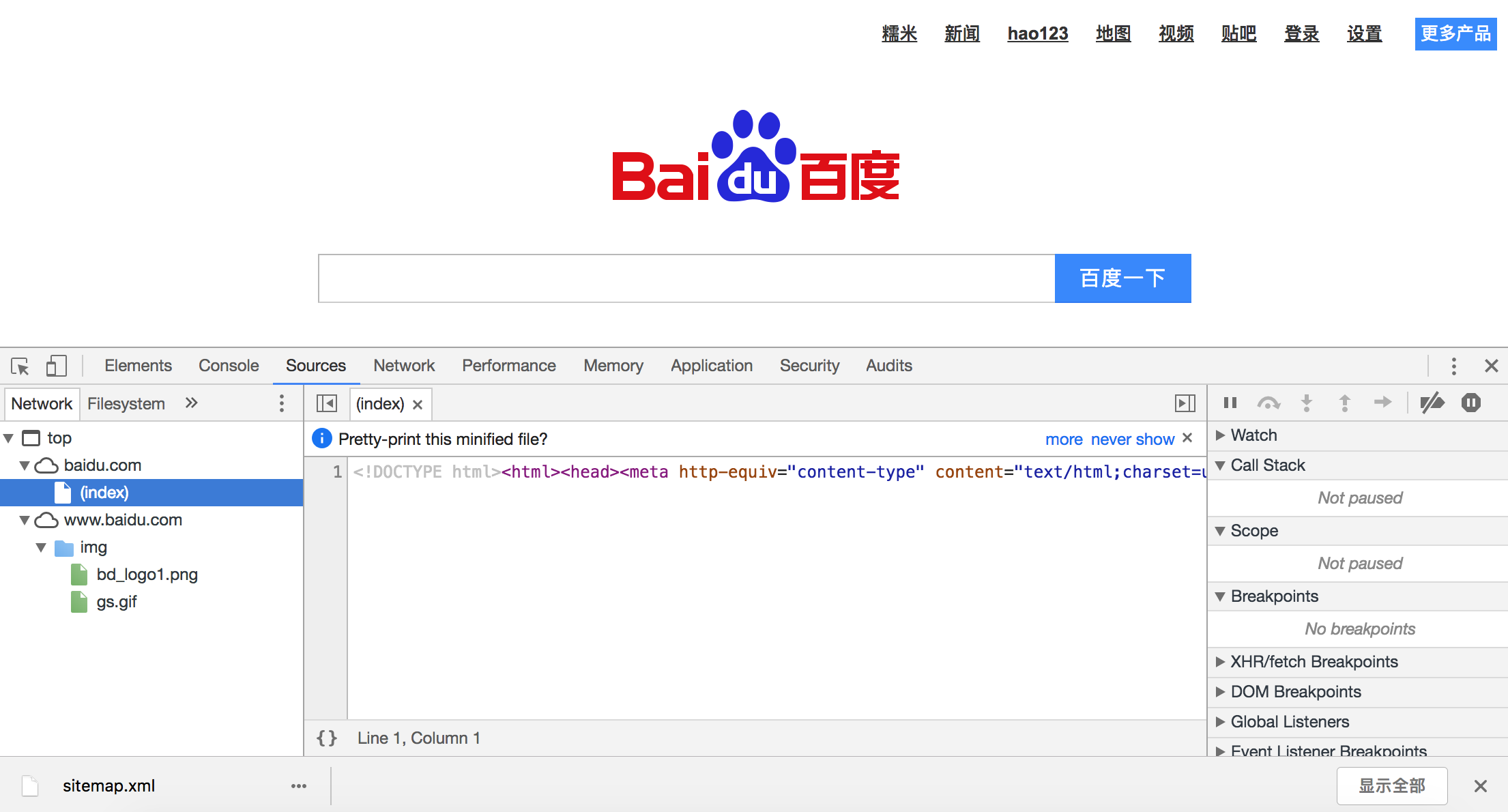

#### PyCharm - Python开发神器

|

||||

|

||||

PyCharm的安装、配置和使用在[《玩转PyCharm》](../玩转PyCharm.md)进行了介绍,有兴趣的读者可以选择阅读。

|

||||

PyCharm的安装、配置和使用在[《玩转PyCharm》](../番外篇/玩转PyCharm.md)进行了介绍,有兴趣的读者可以选择阅读。

|

||||

|

||||

|

||||

|

||||

|

|

|

|||

|

|

@ -193,7 +193,7 @@ c = (f - 32) / 1.8

|

|||

print('%.1f华氏度 = %.1f摄氏度' % (f, c))

|

||||

```

|

||||

|

||||

> **说明**:在使用`print`函数输出时,也可以对字符串内容进行格式化处理,上面`print`函数中的字符串`%1.f`是一个占位符,稍后会由一个`float`类型的变量值替换掉它。同理,如果字符串中有`%d`,后面可以用一个`int`类型的变量值替换掉它,而`%s`会被字符串的值替换掉。除了这种格式化字符串的方式外,还可以用下面的方式来格式化字符串,其中`{f:.1f}`和`{c:.1f}`可以先看成是`{f}`和`{c}`,表示输出时会用变量`f`和变量`c`的值替换掉这两个占位符,后面的`:.1f`表示这是一个浮点数,小数点后保留1位有效数字。

|

||||

> **说明**:在使用`print`函数输出时,也可以对字符串内容进行格式化处理,上面`print`函数中的字符串`%.1f`是一个占位符,稍后会由一个`float`类型的变量值替换掉它。同理,如果字符串中有`%d`,后面可以用一个`int`类型的变量值替换掉它,而`%s`会被字符串的值替换掉。除了这种格式化字符串的方式外,还可以用下面的方式来格式化字符串,其中`{f:.1f}`和`{c:.1f}`可以先看成是`{f}`和`{c}`,表示输出时会用变量`f`和变量`c`的值替换掉这两个占位符,后面的`:.1f`表示这是一个浮点数,小数点后保留1位有效数字。

|

||||

>

|

||||

> ```Python

|

||||

> print(f'{f:.1f}华氏度 = {c:.1f}摄氏度')

|

||||

|

|

|

|||

|

|

@ -168,7 +168,7 @@ y = int(input('y = '))

|

|||

if x > y:

|

||||

# 通过下面的操作将y的值赋给x, 将x的值赋给y

|

||||

x, y = y, x

|

||||

# 从两个数中较的数开始做递减的循环

|

||||

# 从两个数中较小的数开始做递减的循环

|

||||

for factor in range(x, 0, -1):

|

||||

if x % factor == 0 and y % factor == 0:

|

||||

print('%d和%d的最大公约数是%d' % (x, y, factor))

|

||||

|

|

|

|||

|

|

@ -200,7 +200,7 @@ from module1 import foo

|

|||

foo()

|

||||

```

|

||||

|

||||

需要说明的是,如果我们导入的模块除了定义函数之外还中有可以执行代码,那么Python解释器在导入这个模块时就会执行这些代码,事实上我们可能并不希望如此,因此如果我们在模块中编写了执行代码,最好是将这些执行代码放入如下所示的条件中,这样的话除非直接运行该模块,if条件下的这些代码是不会执行的,因为只有直接执行的模块的名字才是"\_\_main\_\_"。

|

||||

需要说明的是,如果我们导入的模块除了定义函数之外还有可以执行代码,那么Python解释器在导入这个模块时就会执行这些代码,事实上我们可能并不希望如此,因此如果我们在模块中编写了执行代码,最好是将这些执行代码放入如下所示的条件中,这样的话除非直接运行该模块,if条件下的这些代码是不会执行的,因为只有直接执行的模块的名字才是"\_\_main\_\_"。

|

||||

|

||||

`module3.py`

|

||||

|

||||

|

|

|

|||

|

|

@ -2,7 +2,7 @@

|

|||

|

||||

### 使用字符串

|

||||

|

||||

第二次世界大战促使了现代电子计算机的诞生,最初计算机被应用于导弹弹道的计算,而在计算机诞生后的很多年时间里,计算机处理的信息基本上都是数值型的信息。世界上的第一台电子计算机叫ENIAC(电子数值积分计算机),诞生于美国的宾夕法尼亚大学,每秒钟能够完成约5000次浮点运算。随着时间的推移,虽然数值运算仍然是计算机日常工作中最为重要的事情之一,但是今天的计算机处理得更多的数据可能都是以文本的方式存在的,如果我们希望通过Python程序操作本这些文本信息,就必须要先了解字符串类型以及与它相关的知识。

|

||||

第二次世界大战促使了现代电子计算机的诞生,最初计算机被应用于导弹弹道的计算,而在计算机诞生后的很多年时间里,计算机处理的信息基本上都是数值型的信息。世界上的第一台电子计算机叫ENIAC(电子数值积分计算机),诞生于美国的宾夕法尼亚大学,每秒钟能够完成约5000次浮点运算。随着时间的推移,虽然数值运算仍然是计算机日常工作中最为重要的事情之一,但是今天的计算机处理得更多的数据可能都是以文本的方式存在的,如果我们希望通过Python程序操作这些文本信息,就必须要先了解字符串类型以及与它相关的知识。

|

||||

|

||||

所谓**字符串**,就是由零个或多个字符组成的有限序列,一般记为。在Python程序中,如果我们把单个或多个字符用单引号或者双引号包围起来,就可以表示一个字符串。

|

||||

|

||||

|

|

|

|||

|

|

@ -9,7 +9,7 @@ Date: 2018-03-02

|

|||

"""

|

||||

import math

|

||||

|

||||

for num in range(1, 10000):

|

||||

for num in range(2, 10000):

|

||||

result = 0

|

||||

for factor in range(1, int(math.sqrt(num)) + 1):

|

||||

if num % factor == 0:

|

||||

|

|

|

|||

|

|

@ -10,24 +10,23 @@ Date: 2018-03-20

|

|||

# 每个进程都有自己独立的内存空间 所以进程之间共享数据只能通过IPC的方式

|

||||

|

||||

|

||||

from multiprocessing import Process, Queue

|

||||

from multiprocessing import Process, Queue, current_process

|

||||

from time import sleep

|

||||

|

||||

|

||||

def sub_task(string, q):

|

||||

number = q.get()

|

||||

while number:

|

||||

print('%d: %s' % (number, string))

|

||||

sleep(0.001)

|

||||

number = q.get()

|

||||

def sub_task(content, counts):

|

||||

print(f'PID: {current_process().pid}')

|

||||

counter = 0

|

||||

while counter < counts:

|

||||

counter += 1

|

||||

print(f'{counter}: {content}')

|

||||

sleep(0.01)

|

||||

|

||||

|

||||

def main():

|

||||

q = Queue(10)

|

||||

for number in range(1, 11):

|

||||

q.put(number)

|

||||

Process(target=sub_task, args=('Ping', q)).start()

|

||||

Process(target=sub_task, args=('Pong', q)).start()

|

||||

number = random.randrange(5, 10)

|

||||

Process(target=sub_task, args=('Ping', number)).start()

|

||||

Process(target=sub_task, args=('Pong', number)).start()

|

||||

|

||||

|

||||

if __name__ == '__main__':

|

||||

|

|

|

|||

|

|

@ -85,7 +85,7 @@

|

|||

常用的工具类:

|

||||

|

||||

- `namedtuple`:命令元组,它是一个类工厂,接受类型的名称和属性列表来创建一个类。

|

||||

- `deque`:双端队列,是列表的替代实现。Python中的列表底层是基于数组来实现的,而deque底层是双向链表,因此当你需要在头尾添加和删除元素是,deque会表现出更好的性能,渐近时间复杂度为$O(1)$。

|

||||

- `deque`:双端队列,是列表的替代实现。Python中的列表底层是基于数组来实现的,而deque底层是双向链表,因此当你需要在头尾添加和删除元素时,deque会表现出更好的性能,渐近时间复杂度为$O(1)$。

|

||||

- `Counter`:`dict`的子类,键是元素,值是元素的计数,它的`most_common()`方法可以帮助我们获取出现频率最高的元素。`Counter`和`dict`的继承关系我认为是值得商榷的,按照CARP原则,`Counter`跟`dict`的关系应该设计为关联关系更为合理。

|

||||

- `OrderedDict`:`dict`的子类,它记录了键值对插入的顺序,看起来既有字典的行为,也有链表的行为。

|

||||

- `defaultdict`:类似于字典类型,但是可以通过默认的工厂函数来获得键对应的默认值,相比字典中的`setdefault()`方法,这种做法更加高效。

|

||||

|

|

@ -1110,19 +1110,6 @@ Python中实现并发编程的三种方案:多线程、多进程和异步I/O

|

|||

self.balance = new_balance

|

||||

|

||||

|

||||

class AddMoneyThread(threading.Thread):

|

||||

"""自定义线程类"""

|

||||

|

||||

def __init__(self, account, money):

|

||||

self.account = account

|

||||

self.money = money

|

||||

# 自定义线程的初始化方法中必须调用父类的初始化方法

|

||||

super().__init__()

|

||||

|

||||

def run(self):

|

||||

# 线程启动之后要执行的操作

|

||||

self.account.deposit(self.money)

|

||||

|

||||

def main():

|

||||

"""主函数"""

|

||||

account = Account()

|

||||

|

|

@ -1130,14 +1117,6 @@ Python中实现并发编程的三种方案:多线程、多进程和异步I/O

|

|||

pool = ThreadPoolExecutor(max_workers=10)

|

||||

futures = []

|

||||

for _ in range(100):

|

||||

# 创建线程的第1种方式

|

||||

# threading.Thread(

|

||||

# target=account.deposit, args=(1, )

|

||||

# ).start()

|

||||

# 创建线程的第2种方式

|

||||

# AddMoneyThread(account, 1).start()

|

||||

# 创建线程的第3种方式

|

||||

# 调用线程池中的线程来执行特定的任务

|

||||

future = pool.submit(account.deposit, 1)

|

||||

futures.append(future)

|

||||

# 关闭线程池

|

||||

|

|

|

|||

|

|

@ -2,6 +2,8 @@

|

|||

|

||||

> **说明**:本文使用的部分插图来自*Jon Duckett*先生的*[HTML and CSS: Design and Build Websites](https://www.amazon.cn/dp/1118008189/ref=sr_1_5?__mk_zh_CN=%E4%BA%9A%E9%A9%AC%E9%80%8A%E7%BD%91%E7%AB%99&keywords=html+%26+css&qid=1554609325&s=gateway&sr=8-5)*一书,这是一本非常棒的前端入门书,有兴趣的读者可以在亚马逊或者其他网站上找到该书的购买链接。

|

||||

|

||||

HTML 是用来描述网页的一种语言,全称是 Hyper-Text Markup Language,即超文本标记语言。我们浏览网页时看到的文字、按钮、图片、视频等元素,它们都是通过 HTML 书写并通过浏览器来呈现的。

|

||||

|

||||

### HTML简史

|

||||

|

||||

1. 1991年10月:一个非正式CERN([欧洲核子研究中心](https://zh.wikipedia.org/wiki/%E6%AD%90%E6%B4%B2%E6%A0%B8%E5%AD%90%E7%A0%94%E7%A9%B6%E7%B5%84%E7%B9%94))文件首次公开18个HTML标签,这个文件的作者是物理学家[蒂姆·伯纳斯-李](https://zh.wikipedia.org/wiki/%E8%92%82%E5%A7%86%C2%B7%E4%BC%AF%E7%BA%B3%E6%96%AF-%E6%9D%8E),因此他是[万维网](https://zh.wikipedia.org/wiki/%E4%B8%87%E7%BB%B4%E7%BD%91)的发明者,也是[万维网联盟](https://zh.wikipedia.org/wiki/%E4%B8%87%E7%BB%B4%E7%BD%91%E8%81%94%E7%9B%9F)的主席。

|

||||

|

|

@ -25,6 +27,10 @@

|

|||

|

||||

### 使用标签承载内容

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211107163448.png" style="zoom:35%">

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211107163741.png" style="zoom:75%">

|

||||

|

||||

#### 结构

|

||||

|

||||

- html

|

||||

|

|

@ -93,11 +99,11 @@

|

|||

|

||||

- 重要属性 - action / method / enctype

|

||||

- 表单控件(input)- type属性

|

||||

- 文本框 - text / 密码框 - password / 数字框 - number

|

||||

- 邮箱 - email / 电话 - tel / 日期 - date / 滑条 - range / URL - url / 搜索 - search

|

||||

- 单选按钮 - radio / 复选按钮 - checkbox

|

||||

- 文件上传 - file / 隐藏域 - hidden

|

||||

- 提交按钮 - submit / 图像按钮 - image / 重置按钮 - reset

|

||||

- 文本框 - `text` / 密码框 - `password` / 数字框 - `number`

|

||||

- 邮箱 - `email` / 电话 - `tel` / 日期 - `date` / 滑条 - `range` / URL - `url` / 搜索 - `search`

|

||||

- 单选按钮 - `radio` / 复选按钮 - `checkbox`

|

||||

- 文件上传 - `file` / 隐藏域 - `hidden`

|

||||

- 提交按钮 - `submit` / 图像按钮 - `image` / 重置按钮 - `reset`

|

||||

- 下拉列表 - select / option

|

||||

- 文本域(多行文本)- textarea

|

||||

- 组合表单元素 - fieldset / legend

|

||||

|

|

@ -259,7 +265,7 @@

|

|||

- 赋值运算符

|

||||

- 算术运算符

|

||||

- 比较运算符

|

||||

- 逻辑运算符

|

||||

- 逻辑运算符:`&&`、`||`、`!`

|

||||

- 分支结构

|

||||

- `if...else...`

|

||||

- `switch...cas...default...`

|

||||

|

|

|

|||

|

|

@ -0,0 +1,97 @@

|

|||

<!DOCTYPE html>

|

||||

<html>

|

||||

<head>

|

||||

<meta charset="utf-8">

|

||||

<title>垃圾分类查询助手</title>

|

||||

<style>

|

||||

.search, .result {

|

||||

width: 720px;

|

||||

margin: 50px auto;

|

||||

}

|

||||

.search > input {

|

||||

width: 520px;

|

||||

border: none;

|

||||

outline: none;

|

||||

text-align: center;

|

||||

font-size: 36px;

|

||||

line-height: 36px;

|

||||

border-bottom: 1px solid gray;

|

||||

margin: 0 20px;

|

||||

}

|

||||

.search button {

|

||||

background-color: red;

|

||||

color: white;

|

||||

font-size: 28px;

|

||||

border: none;

|

||||

outline: none;

|

||||

width: 120px;

|

||||

}

|

||||

.result > p, .result > div {

|

||||

width: 640px;

|

||||

margin: 0 auto;

|

||||

}

|

||||

.result > p, .result span {

|

||||

text-align: left;

|

||||

font-size: 28px;

|

||||

}

|

||||

.result img {

|

||||

vertical-align: middle;

|

||||

}

|

||||

.explain {

|

||||

font-size: 12px;

|

||||

color: darkgray;

|

||||

}

|

||||

.result .pre {

|

||||

font-size: 16px;

|

||||

}

|

||||

</style>

|

||||

</head>

|

||||

<body>

|

||||

<div id="app">

|

||||

<div class="search">

|

||||

<input type="text" placeholder="请输入垃圾名字" v-model.trim="word" @keydown.enter="search()">

|

||||

<button @click="search()">查询</button>

|

||||

</div>

|

||||

<div class="result">

|

||||

<p v-if="searched && !results">没有对应的查询结果</p>

|

||||

<div v-for="result in results">

|

||||

<p>

|

||||

<img :src="'images/' + pictures[result.type]" width="56" :alt="types[result.type]">

|

||||

|

||||

<span>{{ result.name }}</span>

|

||||

|

||||

<span class="pre" v-if="result.aipre == 1">(预测结果)</span>

|

||||

</p>

|

||||

<p class="explain">说明:{{ result.explain }}</p>

|

||||

</div>

|

||||

</div>

|

||||

</div>

|

||||

<script src="https://cdn.bootcss.com/vue/2.6.10/vue.min.js"></script>

|

||||

<script>

|

||||

new Vue({

|

||||

el: '#app',

|

||||

data: {

|

||||

word: '',

|

||||

searched: false,

|

||||

types: ['可回收物', '有害垃圾', '厨余垃圾', '其他垃圾'],

|

||||

pictures: ['recyclable.png', 'harmful-waste.png', 'kitchen-waste.png', 'other-waste.png'],

|

||||

results: []

|

||||

},

|

||||

methods: {

|

||||

search() {

|

||||

if (this.word.trim().length > 0) {

|

||||

let key = 'e8c5524dd2a365f20908ced735f8e480'

|

||||

let url = `http://api.tianapi.com/txapi/lajifenlei/?key=${key}&word=${this.word}`

|

||||

fetch(url)

|

||||

.then(resp => resp.json())

|

||||

.then(json => {

|

||||

this.searched = true

|

||||

this.results = json.newslist

|

||||

})

|

||||

}

|

||||

}

|

||||

}

|

||||

})

|

||||

</script>

|

||||

</body>

|

||||

</html>

|

||||

|

|

@ -748,7 +748,7 @@ Linux系统的命令通常都是如下所示的格式:

|

|||

|

||||

4. 查看和修改密码有效期 - **chage**。

|

||||

|

||||

设置hellokitty用户100天后必须修改密码,过期前15天通知该用户,过期后15天禁用该用户。

|

||||

设置hellokitty用户100天后必须修改密码,过期前15天通知该用户,过期后7天禁用该用户。

|

||||

|

||||

```Shell

|

||||

chage -M 100 -W 15 -I 7 hellokitty

|

||||

|

|

|

|||

|

|

@ -0,0 +1,388 @@

|

|||

## 关系型数据库和MySQL概述

|

||||

|

||||

### 关系型数据库概述

|

||||

|

||||

1. 数据持久化 - 将数据保存到能够长久保存数据的存储介质中,在掉电的情况下数据也不会丢失。

|

||||

|

||||

2. 数据库发展史 - 网状数据库、层次数据库、关系数据库、NoSQL 数据库、NewSQL 数据库。

|

||||

|

||||

> 1970年,IBM的研究员E.F.Codd在*Communication of the ACM*上发表了名为*A Relational Model of Data for Large Shared Data Banks*的论文,提出了**关系模型**的概念,奠定了关系模型的理论基础。后来Codd又陆续发表多篇文章,论述了范式理论和衡量关系系统的12条标准,用数学理论奠定了关系数据库的基础。

|

||||

|

||||

3. 关系数据库特点。

|

||||

|

||||

- 理论基础:**关系代数**(关系运算、集合论、一阶谓词逻辑)。

|

||||

|

||||

- 具体表象:用**二维表**(有行和列)组织数据。

|

||||

|

||||

- 编程语言:**结构化查询语言**(SQL)。

|

||||

|

||||

4. ER模型(实体关系模型)和概念模型图。

|

||||

|

||||

**ER模型**,全称为**实体关系模型**(Entity-Relationship Model),由美籍华裔计算机科学家陈品山先生提出,是概念数据模型的高层描述方式,如下图所示。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20210826003119.png" width="75%">

|

||||

|

||||

- 实体 - 矩形框

|

||||

- 属性 - 椭圆框

|

||||

- 关系 - 菱形框

|

||||

- 重数 - 1:1(一对一) / 1:N(一对多) / M:N(多对多)

|

||||

|

||||

实际项目开发中,我们可以利用数据库建模工具(如:PowerDesigner)来绘制概念数据模型(其本质就是 ER 模型),然后再设置好目标数据库系统,将概念模型转换成物理模型,最终生成创建二维表的 SQL(很多工具都可以根据我们设计的物理模型图以及设定的目标数据库来导出 SQL 或直接生成数据表)。

|

||||

|

||||

|

||||

|

||||

5. 关系数据库产品。

|

||||

- [Oracle](https://www.oracle.com/index.html) - 目前世界上使用最为广泛的数据库管理系统,作为一个通用的数据库系统,它具有完整的数据管理功能;作为一个关系数据库,它是一个完备关系的产品;作为分布式数据库,它实现了分布式处理的功能。在 Oracle 最新的 12c 版本中,还引入了多承租方架构,使用该架构可轻松部署和管理数据库云。

|

||||

- [DB2](https://www.ibm.com/analytics/us/en/db2/) - IBM 公司开发的、主要运行于 Unix(包括 IBM 自家的 [AIX](https://zh.wikipedia.org/wiki/AIX))、Linux、以及 Windows 服务器版等系统的关系数据库产品。DB2 历史悠久且被认为是最早使用 SQL 的数据库产品,它拥有较为强大的商业智能功能。

|

||||

- [SQL Server](https://www.microsoft.com/en-us/sql-server/) - 由 Microsoft 开发和推广的关系型数据库产品,最初适用于中小企业的数据管理,但是近年来它的应用范围有所扩展,部分大企业甚至是跨国公司也开始基于它来构建自己的数据管理系统。

|

||||

- [MySQL](https://www.mysql.com/) - MySQL 是开放源代码的,任何人都可以在 GPL(General Public License)的许可下下载并根据个性化的需要对其进行修改。MySQL 因为其速度、可靠性和适应性而备受关注。

|

||||

- [PostgreSQL]() - 在 BSD 许可证下发行的开放源代码的关系数据库产品。

|

||||

|

||||

### MySQL 简介

|

||||

|

||||

MySQL 最早是由瑞典的 MySQL AB 公司开发的一个开放源码的关系数据库管理系统,该公司于2008年被昇阳微系统公司(Sun Microsystems)收购。在2009年,甲骨文公司(Oracle)收购昇阳微系统公司,因此 MySQL 目前也是 Oracle 旗下产品。

|

||||

|

||||

MySQL 在过去由于性能高、成本低、可靠性好,已经成为最流行的开源数据库,因此被广泛地应用于中小型网站开发。随着 MySQL 的不断成熟,它也逐渐被应用于更多大规模网站和应用,比如维基百科、谷歌(Google)、脸书(Facebook)、淘宝网等网站都使用了 MySQL 来提供数据持久化服务。

|

||||

|

||||

甲骨文公司收购后昇阳微系统公司,大幅调涨 MySQL 商业版的售价,且甲骨文公司不再支持另一个自由软件项目 [OpenSolaris ](https://zh.wikipedia.org/wiki/OpenSolaris) 的发展,因此导致自由软件社区对于 Oracle 是否还会持续支持 MySQL 社区版(MySQL 的各个发行版本中唯一免费的版本)有所担忧,MySQL 的创始人麦克尔·维德纽斯以 MySQL 为基础,创建了 [MariaDB](https://zh.wikipedia.org/wiki/MariaDB)(以他女儿的名字命名的数据库)分支。有许多原来使用 MySQL 数据库的公司(例如:维基百科)已经陆续完成了从 MySQL 数据库到 MariaDB 数据库的迁移。

|

||||

|

||||

### 安装 MySQL

|

||||

|

||||

#### Windows 环境

|

||||

|

||||

1. 通过[官方网站](https://www.mysql.com/)提供的[下载链接](https://dev.mysql.com/downloads/windows/installer/8.0.html)下载“MySQL社区版服务器”安装程序,如下图所示,建议大家下载离线安装版的MySQL Installer。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105230905.png" style="zoom:50%">

|

||||

|

||||

2. 运行 Installer,按照下面的步骤进行安装。

|

||||

|

||||

- 选择自定义安装。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105231152.jpg" style="zoom:35%">

|

||||

|

||||

- 选择需要安装的组件。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105231255.jpg" style="zoom:35%">

|

||||

|

||||

- 如果缺少依赖项,需要先安装依赖项。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105231620.png" style="zoom:35%">

|

||||

|

||||

- 准备开始安装。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105231719.jpg" style="zoom:35%">

|

||||

|

||||

- 安装完成。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105232024.jpg" style="zoom:35%">

|

||||

|

||||

- 准备执行配置向导。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105231815.jpg" style="zoom:35%">

|

||||

|

||||

3. 执行安装后的配置向导。

|

||||

|

||||

- 配置服务器类型和网络。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105232109.jpg" style="zoom:35%">

|

||||

|

||||

- 配置认证方法(保护密码的方式)。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105232408.jpg" style="zoom:35%">

|

||||

|

||||

- 配置用户和角色。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105232521.jpg" style="zoom:35%">

|

||||

|

||||

- 配置Windows服务名以及是否开机自启。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105232608.jpg" style="zoom:35%">

|

||||

|

||||

- 配置日志。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105232641.jpg" style="zoom:35%">

|

||||

|

||||

- 配置高级选项。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105232724.jpg" alt="ACAC15B8633133B65476286A49BFBD7E" style="zoom:35%">

|

||||

|

||||

- 应用配置。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105232800.jpg" style="zoom:35%">

|

||||

|

||||

4. 可以在 Windows 系统的“服务”窗口中启动或停止 MySQL。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105232926.jpg" style="zoom:50%">

|

||||

|

||||

5. 配置 PATH 环境变量,以便在命令行提示符窗口使用 MySQL 客户端工具。

|

||||

|

||||

- 打开 Windows 的“系统”窗口并点击“高级系统设置”。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105233054.jpg" style="zoom:50%">

|

||||

|

||||

- 在“系统属性”的“高级”窗口,点击“环境变量”按钮。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105233312.jpg" style="zoom:50%">

|

||||

|

||||

- 修改PATH环境变量,将MySQL安装路径下的`bin`文件夹的路径配置到PATH环境变量中。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105233359.jpg" style="zoom:50%">

|

||||

|

||||

- 配置完成后,可以尝试在“命令提示符”下使用 MySQL 的命令行工具。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211105233643.jpg" style="zoom:50%">

|

||||

|

||||

#### Linux 环境

|

||||

|

||||

下面以 CentOS 7.x 环境为例,演示如何安装 MySQL 5.7.x,如果需要在其他 Linux 系统下安装其他版本的 MySQL,请读者自行在网络上查找对应的安装教程。

|

||||

|

||||

1. 安装 MySQL。

|

||||

|

||||

可以在 [MySQL 官方网站](<https://www.mysql.com/>)下载安装文件。首先在下载页面中选择平台和版本,然后找到对应的下载链接,直接下载包含所有安装文件的归档文件,解归档之后通过包管理工具进行安装。

|

||||

|

||||

```Shell

|

||||

wget https://dev.mysql.com/get/Downloads/MySQL-5.7/mysql-5.7.26-1.el7.x86_64.rpm-bundle.tar

|

||||

tar -xvf mysql-5.7.26-1.el7.x86_64.rpm-bundle.tar

|

||||

```

|

||||

|

||||

如果系统上有 MariaDB 相关的文件,需要先移除 MariaDB 相关的文件。

|

||||

|

||||

```Shell

|

||||

yum list installed | grep mariadb | awk '{print $1}' | xargs yum erase -y

|

||||

```

|

||||

|

||||

更新和安装可能用到的底层依赖库。

|

||||

|

||||

```Bash

|

||||

yum update

|

||||

yum install -y libaio libaio-devel

|

||||

```

|

||||

|

||||

接下来可以按照如下所示的顺序用 RPM(Redhat Package Manager)工具安装 MySQL。

|

||||

|

||||

```Shell

|

||||

rpm -ivh mysql-community-common-5.7.26-1.el7.x86_64.rpm

|

||||

rpm -ivh mysql-community-libs-5.7.26-1.el7.x86_64.rpm

|

||||

rpm -ivh mysql-community-libs-compat-5.7.26-1.el7.x86_64.rpm

|

||||

rpm -ivh mysql-community-devel-5.7.26-1.el7.x86_64.rpm

|

||||

rpm -ivh mysql-community-client-5.7.26-1.el7.x86_64.rpm

|

||||

rpm -ivh mysql-community-server-5.7.26-1.el7.x86_64.rpm

|

||||

```

|

||||

|

||||

可以使用下面的命令查看已经安装的 MySQL 相关的包。

|

||||

|

||||

```Shell

|

||||

rpm -qa | grep mysql

|

||||

```

|

||||

|

||||

2. 配置 MySQL。

|

||||

|

||||

MySQL 的配置文件在`/etc`目录下,名为`my.cnf`,默认的配置文件内容如下所示。

|

||||

|

||||

```Shell

|

||||

cat /etc/my.cnf

|

||||

```

|

||||

|

||||

```INI

|

||||

# For advice on how to change settings please see

|

||||

# http://dev.mysql.com/doc/refman/5.7/en/server-configuration-defaults.html

|

||||

|

||||

[mysqld]

|

||||

#

|

||||

# Remove leading # and set to the amount of RAM for the most important data

|

||||

# cache in MySQL. Start at 70% of total RAM for dedicated server, else 10%.

|

||||

# innodb_buffer_pool_size = 128M

|

||||

#

|

||||

# Remove leading # to turn on a very important data integrity option: logging

|

||||

# changes to the binary log between backups.

|

||||

# log_bin

|

||||

#

|

||||

# Remove leading # to set options mainly useful for reporting servers.

|

||||

# The server defaults are faster for transactions and fast SELECTs.

|

||||

# Adjust sizes as needed, experiment to find the optimal values.

|

||||

# join_buffer_size = 128M

|

||||

# sort_buffer_size = 2M

|

||||

# read_rnd_buffer_size = 2M

|

||||

datadir=/var/lib/mysql

|

||||

socket=/var/lib/mysql/mysql.sock

|

||||

|

||||

# Disabling symbolic-links is recommended to prevent assorted security risks

|

||||

symbolic-links=0

|

||||

|

||||

log-error=/var/log/mysqld.log

|

||||

pid-file=/var/run/mysqld/mysqld.pid

|

||||

```

|

||||

|

||||

通过配置文件,我们可以修改 MySQL 服务使用的端口、字符集、最大连接数、套接字队列大小、最大数据包大小、日志文件的位置、日志过期时间等配置。当然,我们还可以通过修改配置文件来对 MySQL 服务器进行性能调优和安全管控。

|

||||

|

||||

3. 启动 MySQL 服务。

|

||||

|

||||

可以使用下面的命令来启动 MySQL。

|

||||

|

||||

```Shell

|

||||

service mysqld start

|

||||

```

|

||||

|

||||

在 CentOS 7 中,更推荐使用下面的命令来启动 MySQL。

|

||||

|

||||

```Shell

|

||||

systemctl start mysqld

|

||||

```

|

||||

|

||||

启动 MySQL 成功后,可以通过下面的命令来检查网络端口使用情况,MySQL 默认使用`3306`端口。

|

||||

|

||||

```Shell

|

||||

netstat -ntlp | grep mysql

|

||||

```

|

||||

|

||||

也可以使用下面的命令查找是否有名为`mysqld`的进程。

|

||||

|

||||

```Shell

|

||||

pgrep mysqld

|

||||

```

|

||||

|

||||

4. 使用 MySQL 客户端工具连接服务器。

|

||||

|

||||

命令行工具:

|

||||

|

||||

```Shell

|

||||

mysql -u root -p

|

||||

```

|

||||

|

||||

> 说明:启动客户端时,`-u`参数用来指定用户名,MySQL 默认的超级管理账号为`root`;`-p`表示要输入密码(用户口令);如果连接的是其他主机而非本机,可以用`-h`来指定连接主机的主机名或IP地址。

|

||||

|

||||

如果是首次安装 MySQL,可以使用下面的命令来找到默认的初始密码。

|

||||

|

||||

```Shell

|

||||

cat /var/log/mysqld.log | grep password

|

||||

```

|

||||

|

||||

上面的命令会查看 MySQL 的日志带有`password`的行,在显示的结果中`root@localhost:`后面的部分就是默认设置的初始密码。

|

||||

|

||||

进入客户端工具后,可以通过下面的指令来修改超级管理员(root)的访问口令为`123456`。

|

||||

|

||||

```SQL

|

||||

set global validate_password_policy=0;

|

||||

set global validate_password_length=6;

|

||||

alter user 'root'@'localhost' identified by '123456';

|

||||

```

|

||||

|

||||

> **说明**:MySQL 较新的版本默认不允许使用弱口令作为用户口令,所以上面的代码修改了验证用户口令的策略和口令的长度。事实上我们不应该使用弱口令,因为存在用户口令被暴力破解的风险。近年来,**攻击数据库窃取数据和劫持数据库勒索比特币**的事件屡见不鲜,要避免这些潜在的风险,最为重要的一点是**不要让数据库服务器暴露在公网上**(最好的做法是将数据库置于内网,至少要做到不向公网开放数据库服务器的访问端口),另外要保管好`root`账号的口令,应用系统需要访问数据库时,通常不使用`root`账号进行访问,而是**创建其他拥有适当权限的账号来访问**。

|

||||

|

||||

再次使用客户端工具连接 MySQL 服务器时,就可以使用新设置的口令了。在实际开发中,为了方便用户操作,可以选择图形化的客户端工具来连接 MySQL 服务器,包括:

|

||||

|

||||

- MySQL Workbench(官方工具)

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211106063939.png" style="zoom:50%">

|

||||

|

||||

- Navicat for MySQL(界面简单友好)

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20210521152457.png" style="zoom:50%;">

|

||||

|

||||

|

||||

#### macOS环境

|

||||

|

||||

macOS 系统安装 MySQL 是比较简单的,只需要从刚才说到的官方网站下载 DMG 安装文件并运行就可以了,下载的时候需要根据自己使用的是 Intel 的芯片还是苹果的 M1 芯片选择下载链接,如下图所示。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211121215901.png" style="zoom:50%;">

|

||||

|

||||

安装成功后,可以在“系统偏好设置”中找到“MySQL”,在如下所示的画面中,可以启动和停止 MySQL 服务器,也可以对 MySQL 核心文件的路径进行配置。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211121215153.png" style="zoom:40%;">

|

||||

|

||||

### MySQL 基本命令

|

||||

|

||||

#### 查看命令

|

||||

|

||||

1. 查看所有数据库

|

||||

|

||||

```SQL

|

||||

show databases;

|

||||

```

|

||||

|

||||

2. 查看所有字符集

|

||||

|

||||

```SQL

|

||||

show character set;

|

||||

```

|

||||

|

||||

3. 查看所有的排序规则

|

||||

|

||||

```SQL

|

||||

show collation;

|

||||

```

|

||||

|

||||

4. 查看所有的引擎

|

||||

|

||||

```SQL

|

||||

show engines;

|

||||

```

|

||||

|

||||

5. 查看所有日志文件

|

||||

|

||||

```SQL

|

||||

show binary logs;

|

||||

```

|

||||

|

||||

6. 查看数据库下所有表

|

||||

|

||||

```SQL

|

||||

show tables;

|

||||

```

|

||||

|

||||

#### 获取帮助

|

||||

|

||||

在 MySQL 命令行工具中,可以使用`help`命令或`?`来获取帮助,如下所示。

|

||||

|

||||

1. 查看`show`命令的帮助。

|

||||

|

||||

```MySQL

|

||||

? show

|

||||

```

|

||||

|

||||

2. 查看有哪些帮助内容。

|

||||

|

||||

```MySQL

|

||||

? contents

|

||||

```

|

||||

|

||||

3. 获取函数的帮助。

|

||||

|

||||

```MySQL

|

||||

? functions

|

||||

```

|

||||

|

||||

4. 获取数据类型的帮助。

|

||||

|

||||

```MySQL

|

||||

? data types

|

||||

```

|

||||

|

||||

#### 其他命令

|

||||

|

||||

1. 新建/重建服务器连接 - `connect` / `resetconnection`。

|

||||

|

||||

2. 清空当前输入 - `\c`。在输入错误时,可以及时使用`\c`清空当前输入并重新开始。

|

||||

|

||||

3. 修改终止符(定界符)- `delimiter`。默认的终止符是`;`,可以使用该命令修改成其他的字符,例如修改为`$`符号,可以用`delimiter $`命令。

|

||||

|

||||

4. 打开系统默认编辑器 - `edit`。编辑完成保存关闭之后,命令行会自动执行编辑的内容。

|

||||

|

||||

5. 查看服务器状态 - `status`。

|

||||

|

||||

6. 修改默认提示符 - `prompt`。

|

||||

|

||||

7. 执行系统命令 - `system`。可以将系统命令跟在`system`命令的后面执行,`system`命令也可以缩写为`\!`。

|

||||

|

||||

8. 执行 SQL 文件 - `source`。`source`命令后面跟 SQL 文件路径。

|

||||

|

||||

9. 重定向输出 - `tee` / `notee`。可以将命令的输出重定向到指定的文件中。

|

||||

|

||||

10. 切换数据库 - `use`。

|

||||

|

||||

11. 显示警告信息 - `warnings`。

|

||||

|

||||

12. 退出命令行 - `quit`或`exit`。

|

||||

|

||||

|

||||

|

||||

|

|

@ -0,0 +1,661 @@

|

|||

## 深入MySQL

|

||||

|

||||

### 索引

|

||||

|

||||

索引是关系型数据库中用来提升查询性能最为重要的手段。关系型数据库中的索引就像一本书的目录,我们可以想象一下,如果要从一本书中找出某个知识点,但是这本书没有目录,这将是意见多么可怕的事情!我们估计得一篇一篇的翻下去,才能确定这个知识点到底在什么位置。创建索引虽然会带来存储空间上的开销,就像一本书的目录会占用一部分篇幅一样,但是在牺牲空间后换来的查询时间的减少也是非常显著的。

|

||||

|

||||

MySQL 数据库中所有数据类型的列都可以被索引。对于MySQL 8.0 版本的 InnoDB 存储引擎来说,它支持三种类型的索引,分别是 B+ 树索引、全文索引和 R 树索引。这里,我们只介绍使用得最为广泛的 B+ 树索引。使用 B+ 树的原因非常简单,因为它是目前在基于磁盘进行海量数据存储和排序上最有效率的数据结构。B+ 树是一棵[平衡树](https://zh.wikipedia.org/zh-cn/%E5%B9%B3%E8%A1%A1%E6%A0%91),树的高度通常为3或4,但是却可以保存从百万级到十亿级的数据,而从这些数据里面查询一条数据,只需要3次或4次 I/O 操作。

|

||||

|

||||

B+ 树由根节点、中间节点和叶子节点构成,其中叶子节点用来保存排序后的数据。由于记录在索引上是排序过的,因此在一个叶子节点内查找数据时可以使用二分查找,这种查找方式效率非常的高。当数据很少的时候,B+ 树只有一个根节点,数据也就保存在根节点上。随着记录越来越多,B+ 树会发生分裂,根节点不再保存数据,而是提供了访问下一层节点的指针,帮助快速确定数据在哪个叶子节点上。

|

||||

|

||||

在创建二维表时,我们通常都会为表指定主键列,主键列上默认会创建索引,而对于 MySQL InnoDB 存储引擎来说,因为它使用的是索引组织表这种数据存储结构,所以主键上的索引就是整张表的数据,而这种索引我们也将其称之为**聚集索引**(clustered index)。很显然,一张表只能有一个聚集索引,否则表的数据岂不是要保存多次。我们自己创建的索引都是二级索引(secondary index),更常见的叫法是**非聚集索引**(non-clustered index)。通过我们自定义的非聚集索引只能定位记录的主键,在获取数据时可能需要再通过主键上的聚集索引进行查询,这种现象称为“回表”,因此通过非聚集索引检索数据通常比使用聚集索引检索数据要慢。

|

||||

|

||||

接下来我们通过一个简单的例子来说明索引的意义,比如我们要根据学生的姓名来查找学生,这个场景在实际开发中应该经常遇到,就跟通过商品名称查找商品是一个道理。我们可以使用 MySQL 的`explain`关键字来查看 SQL 的执行计划(数据库执行 SQL 语句的具体步骤)。

|

||||

|

||||

```SQL

|

||||

explain select * from tb_student where stuname='林震南'\G

|

||||

```

|

||||

|

||||

```

|

||||

*************************** 1. row ***************************

|

||||

id: 1

|

||||

select_type: SIMPLE

|

||||

table: tb_student

|

||||

partitions: NULL

|

||||

type: ALL

|

||||

possible_keys: NULL

|

||||

key: NULL

|

||||

key_len: NULL

|

||||

ref: NULL

|

||||

rows: 11

|

||||

filtered: 10.00

|

||||

Extra: Using where

|

||||

1 row in set, 1 warning (0.00 sec)

|

||||

```

|

||||

|

||||

在上面的 SQL 执行计划中,有几项值得我们关注:

|

||||

|

||||

1. `select_type`:查询的类型。

|

||||

- `SIMPLE`:简单 SELECT,不需要使用 UNION 操作或子查询。

|

||||

- `PRIMARY`:如果查询包含子查询,最外层的 SELECT 被标记为 PRIMARY。

|

||||

- `UNION`:UNION 操作中第二个或后面的 SELECT 语句。

|

||||

- `SUBQUERY`:子查询中的第一个 SELECT。

|

||||

- `DERIVED`:派生表的 SELECT 子查询。

|

||||

2. `table`:查询对应的表。

|

||||

3. `type`:MySQL 在表中找到满足条件的行的方式,也称为访问类型,包括:`ALL`(全表扫描)、`index`(索引全扫描,只遍历索引树)、`range`(索引范围扫描)、`ref`(非唯一索引扫描)、`eq_ref`(唯一索引扫描)、`const` / `system`(常量级查询)、`NULL`(不需要访问表或索引)。在所有的访问类型中,很显然 ALL 是性能最差的,它代表的全表扫描是指要扫描表中的每一行才能找到匹配的行。

|

||||

4. `possible_keys`:MySQL 可以选择的索引,但是**有可能不会使用**。

|

||||

5. `key`:MySQL 真正使用的索引,如果为`NULL`就表示没有使用索引。

|

||||

6. `key_len`:使用的索引的长度,在不影响查询的情况下肯定是长度越短越好。

|

||||

7. `rows`:执行查询需要扫描的行数,这是一个**预估值**。

|

||||

8. `extra`:关于查询额外的信息。

|

||||

- `Using filesort`:MySQL 无法利用索引完成排序操作。

|

||||

- `Using index`:只使用索引的信息而不需要进一步查表来获取更多的信息。

|

||||

- `Using temporary`:MySQL 需要使用临时表来存储结果集,常用于分组和排序。

|

||||

- `Impossible where`:`where`子句会导致没有符合条件的行。

|

||||

- `Distinct`:MySQL 发现第一个匹配行后,停止为当前的行组合搜索更多的行。

|

||||

- `Using where`:查询的列未被索引覆盖,筛选条件并不是索引的前导列。

|

||||

|

||||

从上面的执行计划可以看出,当我们通过学生名字查询学生时实际上是进行了全表扫描,不言而喻这个查询性能肯定是非常糟糕的,尤其是在表中的行很多的时候。如果我们需要经常通过学生姓名来查询学生,那么就应该在学生姓名对应的列上创建索引,通过索引来加速查询。

|

||||

|

||||

```SQL

|

||||

create index idx_student_name on tb_student(stuname);

|

||||

```

|

||||

|

||||

再次查看刚才的 SQL 对应的执行计划。

|

||||

|

||||

```SQL

|

||||

explain select * from tb_student where stuname='林震南'\G

|

||||

```

|

||||

|

||||

```

|

||||

*************************** 1. row ***************************

|

||||

id: 1

|

||||

select_type: SIMPLE

|

||||

table: tb_student

|

||||

partitions: NULL

|

||||

type: ref

|

||||

possible_keys: idx_student_name

|

||||

key: idx_student_name

|

||||

key_len: 62

|

||||

ref: const

|

||||

rows: 1

|

||||

filtered: 100.00

|

||||

Extra: NULL

|

||||

1 row in set, 1 warning (0.00 sec)

|

||||

```

|

||||

|

||||

可以注意到,在对学生姓名创建索引后,刚才的查询已经不是全表扫描而是基于索引的查询,而且扫描的行只有唯一的一行,这显然大大的提升了查询的性能。MySQL 中还允许创建前缀索引,即对索引字段的前N个字符创建索引,这样的话可以减少索引占用的空间(但节省了空间很有可能会浪费时间,**时间和空间是不可调和的矛盾**),如下所示。

|

||||

|

||||

```SQL

|

||||

create index idx_student_name_1 on tb_student(stuname(1));

|

||||

```

|

||||

|

||||

上面的索引相当于是根据学生姓名的第一个字来创建的索引,我们再看看 SQL 执行计划。

|

||||

|

||||

```SQL

|

||||

explain select * from tb_student where stuname='林震南'\G

|

||||

```

|

||||

|

||||

```

|

||||

*************************** 1. row ***************************

|

||||

id: 1

|

||||

select_type: SIMPLE

|

||||

table: tb_student

|

||||

partitions: NULL

|

||||

type: ref

|

||||

possible_keys: idx_student_name

|

||||

key: idx_student_name

|

||||

key_len: 5

|

||||

ref: const

|

||||

rows: 2

|

||||

filtered: 100.00

|

||||

Extra: Using where

|

||||

1 row in set, 1 warning (0.00 sec)

|

||||

```

|

||||

|

||||

不知道大家是否注意到,这一次扫描的行变成了2行,因为学生表中有两个姓“林”的学生,我们只用姓名的第一个字作为索引的话,在查询时通过索引就会找到这两行。

|

||||

|

||||

如果要删除索引,可以使用下面的SQL。

|

||||

|

||||

```SQL

|

||||

alter table tb_student drop index idx_student_name;

|

||||

```

|

||||

|

||||

或者

|

||||

|

||||

```SQL

|

||||

drop index idx_student_name on tb_student;

|

||||

```

|

||||

|

||||

在创建索引时,我们还可以使用复合索引、函数索引(MySQL 5.7 开始支持),用好复合索引实现**索引覆盖**可以减少不必要的排序和回表操作,这样就会让查询的性能成倍的提升,有兴趣的读者可以自行研究。

|

||||

|

||||

我们简单的为大家总结一下索引的设计原则:

|

||||

|

||||

1. **最适合**索引的列是出现在**WHERE子句**和连接子句中的列。

|

||||

2. 索引列的基数越大(取值多、重复值少),索引的效果就越好。

|

||||

3. 使用**前缀索引**可以减少索引占用的空间,内存中可以缓存更多的索引。

|

||||

4. **索引不是越多越好**,虽然索引加速了读操作(查询),但是写操作(增、删、改)都会变得更慢,因为数据的变化会导致索引的更新,就如同书籍章节的增删需要更新目录一样。

|

||||

5. 使用 InnoDB 存储引擎时,表的普通索引都会保存主键的值,所以**主键要尽可能选择较短的数据类型**,这样可以有效的减少索引占用的空间,提升索引的缓存效果。

|

||||

|

||||

最后,还有一点需要说明,InnoDB 使用的 B-tree 索引,数值类型的列除了等值判断时索引会生效之外,使用`>`、`<`、`>=`、`<=`、`BETWEEN...AND... `、`<>`时,索引仍然生效;对于字符串类型的列,如果使用不以通配符开头的模糊查询,索引也是起作用的,但是其他的情况会导致索引失效,这就意味着很有可能会做全表查询。

|

||||

|

||||

### 视图

|

||||

|

||||

视图是关系型数据库中将一组查询指令构成的结果集组合成可查询的数据表的对象。简单的说,视图就是虚拟的表,但与数据表不同的是,数据表是一种实体结构,而视图是一种虚拟结构,你也可以将视图理解为保存在数据库中被赋予名字的 SQL 语句。

|

||||

|

||||

使用视图可以获得以下好处:

|

||||

|

||||

1. 可以将实体数据表隐藏起来,让外部程序无法得知实际的数据结构,让访问者可以使用表的组成部分而不是整个表,降低数据库被攻击的风险。

|

||||

2. 在大多数的情况下视图是只读的(更新视图的操作通常都有诸多的限制),外部程序无法直接透过视图修改数据。

|

||||

3. 重用 SQL 语句,将高度复杂的查询包装在视图表中,直接访问该视图即可取出需要的数据;也可以将视图视为数据表进行连接查询。

|

||||

4. 视图可以返回与实体数据表不同格式的数据,在创建视图的时候可以对数据进行格式化处理。

|

||||

|

||||

创建视图。

|

||||

|

||||

```SQL

|

||||

-- 创建视图

|

||||

create view `vw_avg_score`

|

||||

as

|

||||

select `stu_id`, round(avg(`score`), 1) as `avg_score`

|

||||

from `tb_record` group by `stu_id`;

|

||||

|

||||

-- 基于已有的视图创建视图

|

||||

create view `vw_student_score`

|

||||

as

|

||||

select `stu_name`, `avg_score`

|

||||

from `tb_student` natural join `vw_avg_score`;

|

||||

```

|

||||

|

||||

> **提示**:因为视图不包含数据,所以每次使用视图时,都必须执行查询以获得数据,如果你使用了连接查询、嵌套查询创建了较为复杂的视图,你可能会发现查询性能下降得很厉害。因此,在使用复杂的视图前,应该进行测试以确保其性能能够满足应用的需求。

|

||||

|

||||

使用视图。

|

||||

|

||||

```SQL

|

||||

select * from `vw_student_score` order by `avg_score` desc;

|

||||

```

|

||||

|

||||

```

|

||||

+--------------+----------+

|

||||

| stuname | avgscore |

|

||||

+--------------+----------+

|

||||

| 杨过 | 95.6 |

|

||||

| 任我行 | 53.5 |

|

||||

| 王语嫣 | 84.3 |

|

||||

| 纪嫣然 | 73.8 |

|

||||

| 岳不群 | 78.0 |

|

||||

| 东方不败 | 88.0 |

|

||||

| 项少龙 | 92.0 |

|

||||

+--------------+----------+

|

||||

```

|

||||

|

||||

既然视图是一张虚拟的表,那么视图的中的数据可以更新吗?视图的可更新性要视具体情况而定,以下类型的视图是不能更新的:

|

||||

|

||||

1. 使用了聚合函数(`SUM`、`MIN`、`MAX`、`AVG`、`COUNT`等)、`DISTINCT`、`GROUP BY`、`HAVING`、`UNION`或者`UNION ALL`的视图。

|

||||

2. `SELECT`中包含了子查询的视图。

|

||||

3. `FROM`子句中包含了一个不能更新的视图的视图。

|

||||

4. `WHERE`子句的子查询引用了`FROM`子句中的表的视图。

|

||||

|

||||

删除视图。

|

||||

|

||||

```SQL

|

||||

drop view vw_student_score;

|

||||

```

|

||||

|

||||

> **说明**:如果希望更新视图,可以先用上面的命令删除视图,也可以通过`create or replace view`来更新视图。

|

||||

|

||||

视图的规则和限制。

|

||||

|

||||

1. 视图可以嵌套,可以利用从其他视图中检索的数据来构造一个新的视图。视图也可以和表一起使用。

|

||||

2. 创建视图时可以使用`order by`子句,但如果从视图中检索数据时也使用了`order by`,那么该视图中原先的`order by`会被覆盖。

|

||||

3. 视图无法使用索引,也不会激发触发器(实际开发中因为性能等各方面的考虑,通常不建议使用触发器,所以我们也不对这个概念进行介绍)的执行。

|

||||

|

||||

### 函数

|

||||

|

||||

MySQL 中的函数跟 Python 中的函数太多的差异,因为函数都是用来封装功能上相对独立且会被重复使用的代码的。如果非要找出一些差别来,那么 MySQL 中的函数是可以执行 SQL 语句的。下面的例子,我们通过自定义函数实现了截断超长字符串的功能。

|

||||

|

||||

```SQL

|

||||

delimiter $$

|

||||

|

||||

create function truncate_string(

|

||||

content varchar(10000),

|

||||

max_length int unsigned

|

||||

) returns varchar(10000) no sql

|

||||

begin

|

||||

declare result varchar(10000) default content;

|

||||

if char_length(content) > max_length then

|

||||

set result = left(content, max_length);

|

||||

set result = concat(result, '……');

|

||||

end if;

|

||||

return result;

|

||||

end $$

|

||||

|

||||

delimiter ;

|

||||

```

|

||||

|

||||

> **说明1**:函数声明后面的`no sql`是声明函数体并没有使用 SQL 语句;如果函数体中需要通过 SQL 读取数据,需要声明为`reads sql data`。

|

||||

>

|

||||

> **说明2**:定义函数前后的`delimiter`命令是为了修改定界符,因为函数体中的语句都是用`;`表示结束,如果不重新定义定界符,那么遇到的`;`的时候代码就会被截断执行,显然这不是我们想要的效果。

|

||||

|

||||

在查询中调用自定义函数。

|

||||

|

||||

```SQL

|

||||

select truncate_string('和我在成都的街头走一走,直到所有的灯都熄灭了也不停留', 10) as short_string;

|

||||

```

|

||||

|

||||

```

|

||||

+--------------------------------------+

|

||||

| short_string |

|

||||

+--------------------------------------+

|

||||

| 和我在成都的街头走一…… |

|

||||

+--------------------------------------+

|

||||

```

|

||||

|

||||

### 过程

|

||||

|

||||

过程(又称存储过程)是事先编译好存储在数据库中的一组 SQL 的集合,调用过程可以简化应用程序开发人员的工作,减少与数据库服务器之间的通信,对于提升数据操作的性能也是有帮助的。其实迄今为止,我们使用的 SQL 语句都是针对一个或多个表的单条语句,但在实际开发中经常会遇到某个操作需要多条 SQL 语句才能完成的情况。例如,电商网站在受理用户订单时,需要做以下一系列的处理。

|

||||

|

||||

1. 通过查询来核对库存中是否有对应的物品以及库存是否充足。

|

||||

2. 如果库存有物品,需要锁定库存以确保这些物品不再卖给别人, 并且要减少可用的物品数量以反映正确的库存量。

|

||||

3. 如果库存不足,可能需要进一步与供应商进行交互或者至少产生一条系统提示消息。

|

||||

4. 不管受理订单是否成功,都需要产生流水记录,而且需要给对应的用户产生一条通知信息。

|

||||

|

||||

我们可以通过过程将复杂的操作封装起来,这样不仅有助于保证数据的一致性,而且将来如果业务发生了变动,只需要调整和修改过程即可。对于调用过程的用户来说,过程并没有暴露数据表的细节,而且执行过程比一条条的执行一组 SQL 要快得多。

|

||||

|

||||

下面的过程实现了查询某门课程的最高分、最低分和平均分。

|

||||

|

||||

```SQL

|

||||

drop procedure if exists sp_score_stat;

|

||||

|

||||

delimiter $$

|

||||

|

||||

create procedure sp_score_stat(

|

||||

courseId int,

|

||||

out maxScore decimal(4,1),

|

||||

out minScore decimal(4,1),

|

||||

out avgScore decimal(4,1)

|

||||

)

|

||||

begin

|

||||

select max(score) into maxScore from tb_record where cou_id=courseId;

|

||||

select min(score) into minScore from tb_record where cou_id=courseId;

|

||||

select avg(score) into avgScore from tb_record where cou_id=courseId;

|

||||

end $$

|

||||

|

||||

delimiter ;

|

||||

```

|

||||

|

||||

> **说明**:在定义过程时,因为可能需要书写多条 SQL,而分隔这些 SQL 需要使用分号作为分隔符,如果这个时候,仍然用分号表示整段代码结束,那么定义过程的 SQL 就会出现错误,所以上面我们用`delimiter $$`将整段代码结束的标记定义为`$$`,那么代码中的分号将不再表示整段代码的结束,整段代码只会在遇到`end $$`时才会执行。在定义完过程后,通过`delimiter ;`将结束符重新改回成分号(恢复现场)。

|

||||

|

||||

上面定义的过程有四个参数,其中第一个参数是输入参数,代表课程的编号,后面的参数都是输出参数,因为过程不能定义返回值,只能通过输出参数将执行结果带出,定义输出参数的关键字是`out`,默认情况下参数都是输入参数。

|

||||

|

||||

调用过程。

|

||||

|

||||

```SQL

|

||||

call sp_score_stat(1111, @a, @b, @c);

|

||||

```

|

||||

|

||||

获取输出参数的值。

|

||||

|

||||

```SQL

|

||||

select @a as 最高分, @b as 最低分, @c as 平均分;

|

||||

```

|

||||

|

||||

删除过程。

|

||||

|

||||

```SQL

|

||||

drop procedure sp_score_stat;

|

||||

```

|

||||

|

||||

在过程中,我们可以定义变量、条件,可以使用分支和循环语句,可以通过游标操作查询结果,还可以使用事件调度器,这些内容我们暂时不在此处进行介绍。虽然我们说了很多过程的好处,但是在实际开发中,如果频繁的使用过程并将大量复杂的运算放到过程中,会给据库服务器造成巨大的压力,而数据库往往都是性能瓶颈所在,使用过程无疑是雪上加霜的操作。所以,对于互联网产品开发,我们一般建议让数据库只做好存储,复杂的运算和处理交给应用服务器上的程序去完成,如果应用服务器变得不堪重负了,我们可以比较容易的部署多台应用服务器来分摊这些压力。

|

||||

|

||||

如果大家对上面讲到的视图、函数、过程包括我们没有讲到的触发器这些知识有兴趣,建议大家阅读 MySQL 的入门读物[《MySQL必知必会》](https://item.jd.com/12818982.html)进行一般性了解即可,因为这些知识点在大家将来的工作中未必用得上,学了也可能仅仅是为了应付面试而已。

|

||||

|

||||

### MySQL 新特性

|

||||

|

||||

#### JSON类型

|

||||

|

||||

很多开发者在使用关系型数据库做数据持久化的时候,常常感到结构化的存储缺乏灵活性,因为必须事先设计好所有的列以及对应的数据类型。在业务发展和变化的过程中,如果需要修改表结构,这绝对是比较麻烦和难受的事情。从 MySQL 5.7 版本开始,MySQL引入了对 JSON 数据类型的支持(MySQL 8.0 解决了 JSON 的日志性能瓶颈问题),用好 JSON 类型,其实就是打破了关系型数据库和非关系型数据库之间的界限,为数据持久化操作带来了更多的便捷。

|

||||

|

||||

JSON 类型主要分为 JSON 对象和 JSON数组两种,如下所示。

|

||||

|

||||

1. JSON 对象

|

||||

|

||||

```JSON

|

||||

{"name": "骆昊", "tel": "13122335566", "QQ": "957658"}

|

||||

```

|

||||

|

||||

2. JSON 数组

|

||||

|

||||

```JSON

|

||||

[1, 2, 3]

|

||||

```

|

||||

|

||||

```JSON

|

||||

[{"name": "骆昊", "tel": "13122335566"}, {"name": "王大锤", "QQ": "123456"}]

|

||||

```

|

||||

|

||||

哪些地方需要用到JSON类型呢?举一个简单的例子,现在很多产品的用户登录都支持多种方式,例如手机号、微信、QQ、新浪微博等,但是一般情况下我们又不会要求用户提供所有的这些信息,那么用传统的设计方式,就需要设计多个列来对应多种登录方式,可能还需要允许这些列存在空值,这显然不是很好的选择;另一方面,如果产品又增加了一种登录方式,那么就必然要修改之前的表结构,这就更让人痛苦了。但是,有了 JSON 类型,刚才的问题就迎刃而解了,我们可以做出如下所示的设计。

|

||||

|

||||

```SQL

|

||||

create table `tb_test`

|

||||

(

|

||||

`user_id` bigint unsigned,

|

||||

`login_info` json,

|

||||

primary key (`user_id`)

|

||||

) engine=innodb;

|

||||

|

||||

insert into `tb_test` values

|

||||

(1, '{"tel": "13122335566", "QQ": "654321", "wechat": "jackfrued"}'),

|

||||

(2, '{"tel": "13599876543", "weibo": "wangdachui123"}');

|

||||

```

|

||||

|

||||

如果要查询用户的手机和微信号,可以用如下所示的 SQL 语句。

|

||||

|

||||

```SQL

|

||||

select

|

||||

`user_id`,

|

||||

json_unquote(json_extract(`login_info`, '$.tel')) as 手机号,

|

||||

json_unquote(json_extract(`login_info`, '$.wechat')) as 微信

|

||||

from `tb_test`;

|

||||

```

|

||||

|

||||

```

|

||||

+---------+-------------+-----------+

|

||||

| user_id | 手机号 | 微信 |

|

||||

+---------+-------------+-----------+

|

||||

| 1 | 13122335566 | jackfrued |

|

||||

| 2 | 13599876543 | NULL |

|

||||

+---------+-------------+-----------+

|

||||

```

|

||||

|

||||

因为支持 JSON 类型,MySQL 也提供了配套的处理 JSON 数据的函数,就像上面用到的`json_extract`和`json_unquote`。当然,上面的 SQL 还有更为便捷的写法,如下所示。

|

||||

|

||||

```SQL

|

||||

select

|

||||

`user_id`,

|

||||

`login_info` ->> '$.tel' as 手机号,

|

||||

`login_info` ->> '$.wechat' as 微信

|

||||

from `tb_test`;

|

||||

```

|

||||

|

||||

再举个例子,如果我们的产品要实现用户画像功能(给用户打标签),然后基于用户画像给用户推荐平台的服务或消费品之类的东西,我们也可以使用 JSON 类型来保存用户画像数据,示意代码如下所示。

|

||||

|

||||

创建画像标签表。

|

||||

|

||||

```SQL

|

||||

create table `tb_tags`

|

||||

(

|

||||

`tag_id` int unsigned not null comment '标签ID',

|

||||

`tag_name` varchar(20) not null comment '标签名',

|

||||

primary key (`tag_id`)

|

||||

) engine=innodb;

|

||||

|

||||

insert into `tb_tags` (`tag_id`, `tag_name`)

|

||||

values

|

||||

(1, '70后'),

|

||||

(2, '80后'),

|

||||

(3, '90后'),

|

||||

(4, '00后'),

|

||||

(5, '爱运动'),

|

||||

(6, '高学历'),

|

||||

(7, '小资'),

|

||||

(8, '有房'),

|

||||

(9, '有车'),

|

||||

(10, '爱看电影'),

|

||||

(11, '爱网购'),

|

||||

(12, '常点外卖');

|

||||

```

|

||||

|

||||

为用户打标签。

|

||||

|

||||

```SQL

|

||||

create table `tb_users_tags`

|

||||

(

|

||||

`user_id` bigint unsigned not null comment '用户ID',

|

||||

`user_tags` json not null comment '用户标签'

|

||||

) engine=innodb;

|

||||

|

||||

insert into `tb_users_tags` values

|

||||

(1, '[2, 6, 8, 10]'),

|

||||

(2, '[3, 10, 12]'),

|

||||

(3, '[3, 8, 9, 11]');

|

||||

```

|

||||

|

||||

接下来,我们通过一组查询来了解 JSON 类型的巧妙之处。

|

||||

|

||||

1. 查询爱看电影(有`10`这个标签)的用户ID。

|

||||

|

||||

```SQL

|

||||

select * from `tb_users` where 10 member of (user_tags->'$');

|

||||

```

|

||||

|

||||

2. 查询爱看电影(有`10`这个标签)的80后(有`2`这个标签)用户ID。

|

||||

|

||||

```

|

||||

select * from `tb_users` where json_contains(user_tags->'$', '[2, 10]');

|

||||

|

||||

3. 查询爱看电影或80后或90后的用户ID。

|

||||

|

||||

```SQL

|

||||

select `user_id` from `tb_users_tags` where json_overlaps(user_tags->'$', '[2, 3, 10]');

|

||||

```

|

||||

|

||||

> **说明**:上面的查询用到了`member of`谓词和两个 JSON 函数,`json_contains`可以检查 JSON 数组是否包含了指定的元素,而`json_overlaps`可以检查 JSON 数组是否与指定的数组有重叠部分。

|

||||

|

||||

#### 窗口函数

|

||||

|

||||

MySQL 从8.0开始支持窗口函数,大多数商业数据库和一些开源数据库早已提供了对窗口函数的支持,有的也将其称之为 OLAP(联机分析和处理)函数,听名字就知道跟统计和分析相关。为了帮助大家理解窗口函数,我们先说说窗口的概念。

|

||||

|

||||

窗口可以理解为记录的集合,窗口函数也就是在满足某种条件的记录集合上执行的特殊函数,对于每条记录都要在此窗口内执行函数。窗口函数和我们上面讲到的聚合函数比较容易混淆,二者的区别主要在于聚合函数是将多条记录聚合为一条记录,窗口函数是每条记录都会执行,执行后记录条数不会变。窗口函数不仅仅是几个函数,它是一套完整的语法,函数只是该语法的一部分,基本语法如下所示:

|

||||

|

||||

```SQL

|

||||

<窗口函数> over (partition by <用于分组的列名> order by <用户排序的列名>)

|

||||

```

|

||||

|

||||

上面语法中,窗口函数的位置可以放以下两种函数:

|

||||

|

||||

1. 专用窗口函数,包括:`lead`、`lag`、`first_value`、`last_value`、`rank`、`dense_rank`和`row_number`等。

|

||||

2. 聚合函数,包括:`sum`、`avg`、`max`、`min`和`count`等。

|

||||

|

||||

下面为大家举几个使用窗口函数的简单例子,我们先用如下所示的 SQL 建库建表。

|

||||

|

||||

```SQL

|

||||

-- 创建名为hrs的数据库并指定默认的字符集

|

||||

create database `hrs` default charset utf8mb4;

|

||||

|

||||

-- 切换到hrs数据库

|

||||

use `hrs`;

|

||||

|

||||

-- 创建部门表

|

||||

create table `tb_dept`

|

||||

(

|

||||

`dno` int not null comment '编号',

|

||||

`dname` varchar(10) not null comment '名称',

|

||||

`dloc` varchar(20) not null comment '所在地',

|

||||

primary key (`dno`)

|

||||

);

|

||||

|

||||

-- 插入4个部门

|

||||

insert into `tb_dept` values

|

||||

(10, '会计部', '北京'),

|

||||

(20, '研发部', '成都'),

|

||||

(30, '销售部', '重庆'),

|

||||

(40, '运维部', '深圳');

|

||||

|

||||

-- 创建员工表

|

||||

create table `tb_emp`

|

||||

(

|

||||

`eno` int not null comment '员工编号',

|

||||

`ename` varchar(20) not null comment '员工姓名',

|

||||

`job` varchar(20) not null comment '员工职位',

|

||||

`mgr` int comment '主管编号',

|

||||

`sal` int not null comment '员工月薪',

|

||||

`comm` int comment '每月补贴',

|

||||

`dno` int not null comment '所在部门编号',

|

||||

primary key (`eno`),

|

||||

constraint `fk_emp_mgr` foreign key (`mgr`) references tb_emp (`eno`),

|

||||

constraint `fk_emp_dno` foreign key (`dno`) references tb_dept (`dno`)

|

||||

);

|

||||

|

||||

-- 插入14个员工

|

||||

insert into `tb_emp` values

|

||||

(7800, '张三丰', '总裁', null, 9000, 1200, 20),

|

||||

(2056, '乔峰', '分析师', 7800, 5000, 1500, 20),

|

||||

(3088, '李莫愁', '设计师', 2056, 3500, 800, 20),

|

||||

(3211, '张无忌', '程序员', 2056, 3200, null, 20),

|

||||

(3233, '丘处机', '程序员', 2056, 3400, null, 20),

|

||||

(3251, '张翠山', '程序员', 2056, 4000, null, 20),

|

||||

(5566, '宋远桥', '会计师', 7800, 4000, 1000, 10),

|

||||

(5234, '郭靖', '出纳', 5566, 2000, null, 10),

|

||||

(3344, '黄蓉', '销售主管', 7800, 3000, 800, 30),

|

||||

(1359, '胡一刀', '销售员', 3344, 1800, 200, 30),

|

||||

(4466, '苗人凤', '销售员', 3344, 2500, null, 30),

|

||||

(3244, '欧阳锋', '程序员', 3088, 3200, null, 20),

|

||||

(3577, '杨过', '会计', 5566, 2200, null, 10),

|

||||

(3588, '朱九真', '会计', 5566, 2500, null, 10);

|

||||

```

|

||||

|

||||

例子1:查询按月薪从高到低排在第4到第6名的员工的姓名和月薪。

|

||||

|

||||

```SQL

|

||||

select * from (

|

||||

select

|

||||

`ename`, `sal`,

|

||||

row_number() over (order by `sal` desc) as `rank`

|

||||

from `tb_emp`

|

||||

) `temp` where `rank` between 4 and 6;

|

||||

```

|

||||

|

||||

> **说明**:上面使用的函数`row_number()`可以为每条记录生成一个行号,在实际工作中可以根据需要将其替换为`rank()`或`dense_rank()`函数,三者的区别可以参考官方文档或阅读[《通俗易懂的学会:SQL窗口函数》](https://zhuanlan.zhihu.com/p/92654574)进行了解。在MySQL 8以前的版本,我们可以通过下面的方式来完成类似的操作。

|

||||

>

|

||||

> ```SQL

|

||||

> select `rank`, `ename`, `sal` from (

|

||||

> select @a:=@a+1 as `rank`, `ename`, `sal`

|

||||

> from `tb_emp`, (select @a:=0) as t1 order by `sal` desc

|

||||

> ) t2 where `rank` between 4 and 6;

|

||||

> ```

|

||||

|

||||

例子2:查询每个部门月薪最高的两名的员工的姓名和部门名称。

|

||||

|

||||

```SQL

|

||||

select `ename`, `sal`, `dname`

|

||||

from (

|

||||

select

|

||||

`ename`, `sal`, `dno`,

|

||||

rank() over (partition by `dno` order by `sal` desc) as `rank`

|

||||

from `tb_emp`

|

||||

) as `temp` natural join `tb_dept` where `rank`<=2;

|

||||

```

|

||||

|

||||

> 说明:在MySQL 8以前的版本,我们可以通过下面的方式来完成类似的操作。

|

||||

>

|

||||

> ```SQL

|

||||

> select `ename`, `sal`, `dname` from `tb_emp` as `t1`

|

||||

natural join `tb_dept`

|

||||

where (

|

||||

select count(*) from `tb_emp` as `t2`

|

||||

where `t1`.`dno`=`t2`.`dno` and `t2`.`sal`>`t1`.`sal`

|

||||

)<2 order by `dno` asc, `sal` desc;

|

||||

> ```

|

||||

|

||||

### 其他内容

|

||||

|

||||

#### 范式理论

|

||||

|

||||

范式理论是设计关系型数据库中二维表的指导思想。

|

||||

|

||||

1. 第一范式:数据表的每个列的值域都是由原子值组成的,不能够再分割。

|

||||

2. 第二范式:数据表里的所有数据都要和该数据表的键(主键与候选键)有完全依赖关系。

|

||||

3. 第三范式:所有非键属性都只和候选键有相关性,也就是说非键属性之间应该是独立无关的。

|

||||

|

||||

> **说明**:实际工作中,出于效率的考虑,我们在设计表时很有可能做出反范式设计,即故意降低方式级别,增加冗余数据来获得更好的操作性能。

|

||||

|

||||

#### 数据完整性

|

||||

|

||||

1. 实体完整性 - 每个实体都是独一无二的

|

||||

|

||||

- 主键(`primary key`) / 唯一约束(`unique`)

|

||||

2. 引用完整性(参照完整性)- 关系中不允许引用不存在的实体

|

||||

|

||||

- 外键(`foreign key`)

|

||||

3. 域(domain)完整性 - 数据是有效的

|

||||

- 数据类型及长度

|

||||

|

||||

- 非空约束(`not null`)

|

||||

|

||||

- 默认值约束(`default`)

|

||||

|

||||

- 检查约束(`check`)

|

||||

|

||||

> **说明**:在 MySQL 8.x 以前,检查约束并不起作用。

|

||||

|

||||

#### 数据一致性

|

||||

|

||||

1. 事务:一系列对数据库进行读/写的操作,这些操作要么全都成功,要么全都失败。

|

||||

|

||||

2. 事务的 ACID 特性

|

||||

- 原子性:事务作为一个整体被执行,包含在其中的对数据库的操作要么全部被执行,要么都不执行

|

||||

- 一致性:事务应确保数据库的状态从一个一致状态转变为另一个一致状态

|

||||

- 隔离性:多个事务并发执行时,一个事务的执行不应影响其他事务的执行

|

||||

- 持久性:已被提交的事务对数据库的修改应该永久保存在数据库中

|

||||

|

||||

3. MySQL 中的事务操作

|

||||

|

||||

- 开启事务环境

|

||||

|

||||

```SQL

|

||||

start transaction

|

||||

```

|

||||

|

||||

- 提交事务

|

||||

|

||||

```SQL

|

||||

commit

|

||||

```

|

||||

|

||||

- 回滚事务

|

||||

|

||||

```SQL

|

||||

rollback

|

||||

```

|

||||

|

||||

4. 查看事务隔离级别

|

||||

|

||||

```SQL

|

||||

show variables like 'transaction_isolation';

|

||||

```

|

||||

|

||||

```

|

||||

+-----------------------+-----------------+

|

||||

| Variable_name | Value |

|

||||

+-----------------------+-----------------+

|

||||

| transaction_isolation | REPEATABLE-READ |

|

||||

+-----------------------+-----------------+

|

||||

```

|

||||

|

||||

可以看出,MySQL 默认的事务隔离级别是`REPEATABLE-READ`。

|

||||

|

||||

5. 修改(当前会话)事务隔离级别

|

||||

|

||||

```SQL

|

||||

set session transaction isolation level read committed;

|

||||

```

|

||||

|

||||

重新查看事务隔离级别,结果如下所示。

|

||||

|

||||

```

|

||||

+-----------------------+----------------+

|

||||

| Variable_name | Value |

|

||||

+-----------------------+----------------+

|

||||

| transaction_isolation | READ-COMMITTED |

|

||||

+-----------------------+----------------+

|

||||

```

|

||||

|

||||

关系型数据库的事务是一个很大的话题,因为当存在多个并发事务访问数据时,就有可能出现三类读数据的问题(脏读、不可重复读、幻读)和两类更新数据的问题(第一类丢失更新、第二类丢失更新)。想了解这五类问题的,可以阅读我发布在 CSDN 网站上的[《Java面试题全集(上)》](https://blog.csdn.net/jackfrued/article/details/44921941)一文的第80题。为了避免这些问题,关系型数据库底层是有对应的锁机制的,按锁定对象不同可以分为表级锁和行级锁,按并发事务锁定关系可以分为共享锁和独占锁。然而直接使用锁是非常麻烦的,为此数据库为用户提供了自动锁机制,只要用户指定适当的事务隔离级别,数据库就会通过分析 SQL 语句,然后为事务访问的资源加上合适的锁。此外,数据库还会维护这些锁通过各种手段提高系统的性能,这些对用户来说都是透明的。想了解 MySQL 事务和锁的细节知识,推荐大家阅读进阶读物[《高性能MySQL》](https://item.jd.com/11220393.html),这也是数据库方面的经典书籍。

|

||||

|

||||

ANSI/ISO SQL 92标准定义了4个等级的事务隔离级别,如下表所示。需要说明的是,事务隔离级别和数据访问的并发性是对立的,事务隔离级别越高并发性就越差。所以要根据具体的应用来确定到底使用哪种事务隔离级别,这个地方没有万能的原则。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211121225327.png" style="zoom:50%;">

|

||||

|

||||

### 总结

|

||||

|

||||

关于 SQL 和 MySQL 的知识肯定远远不止上面列出的这些,比如 SQL 本身的优化、MySQL 性能调优、MySQL 运维相关工具、MySQL 数据的备份和恢复、监控 MySQL 服务、部署高可用架构等,这一系列的问题在这里都没有办法逐一展开来讨论,那就留到有需要的时候再进行讲解吧,各位读者也可以自行探索。

|

||||

|

|

@ -0,0 +1,102 @@

|

|||

## 数据库相关知识

|

||||

|

||||

### 范式理论

|

||||

|

||||

范式理论是设计关系型数据库中二维表的指导思想。

|

||||

|

||||

1. 第一范式:数据表的每个列的值域都是由原子值组成的,不能够再分割。

|

||||

2. 第二范式:数据表里的所有数据都要和该数据表的键(主键与候选键)有完全依赖关系。

|

||||

3. 第三范式:所有非键属性都只和候选键有相关性,也就是说非键属性之间应该是独立无关的。

|

||||

|

||||

> **说明**:实际工作中,出于效率的考虑,我们在设计表时很有可能做出反范式设计,即故意降低方式级别,增加冗余数据来获得更好的操作性能。

|

||||

|

||||

### 数据完整性

|

||||

|

||||

1. 实体完整性 - 每个实体都是独一无二的

|

||||

|

||||

- 主键(`primary key`) / 唯一约束(`unique`)

|

||||

2. 引用完整性(参照完整性)- 关系中不允许引用不存在的实体

|

||||

|

||||

- 外键(`foreign key`)

|

||||

3. 域(domain)完整性 - 数据是有效的

|

||||

- 数据类型及长度

|

||||

|

||||

- 非空约束(`not null`)

|

||||

|

||||

- 默认值约束(`default`)

|

||||

|

||||

- 检查约束(`check`)

|

||||

|

||||

> **说明**:在 MySQL 8.x 以前,检查约束并不起作用。

|

||||

|

||||

### 数据一致性

|

||||

|

||||

1. 事务:一系列对数据库进行读/写的操作,这些操作要么全都成功,要么全都失败。

|

||||

|

||||

2. 事务的 ACID 特性

|

||||

- 原子性:事务作为一个整体被执行,包含在其中的对数据库的操作要么全部被执行,要么都不执行

|

||||

- 一致性:事务应确保数据库的状态从一个一致状态转变为另一个一致状态

|

||||

- 隔离性:多个事务并发执行时,一个事务的执行不应影响其他事务的执行

|

||||

- 持久性:已被提交的事务对数据库的修改应该永久保存在数据库中

|

||||

|

||||

3. MySQL 中的事务操作

|

||||

|

||||

- 开启事务环境

|

||||

|

||||

```SQL

|

||||

start transaction

|

||||

```

|

||||

|

||||

- 提交事务

|

||||

|

||||

```SQL

|

||||

commit

|

||||

```

|

||||

|

||||

- 回滚事务

|

||||

|

||||

```SQL

|

||||

rollback

|

||||

```

|

||||

|

||||

4. 查看事务隔离级别

|

||||

|

||||

```SQL

|

||||

show variables like 'transaction_isolation';

|

||||

```

|

||||

|

||||

```

|

||||

+-----------------------+-----------------+

|

||||

| Variable_name | Value |

|

||||

+-----------------------+-----------------+

|

||||

| transaction_isolation | REPEATABLE-READ |

|

||||

+-----------------------+-----------------+

|

||||

```

|

||||

|

||||

可以看出,MySQL 默认的事务隔离级别是`REPEATABLE-READ`。

|

||||

|

||||

5. 修改(当前会话)事务隔离级别

|

||||

|

||||

```SQL

|

||||

set session transaction isolation level read committed;

|

||||

```

|

||||

|

||||

重新查看事务隔离级别,结果如下所示。

|

||||

|

||||

```

|

||||

+-----------------------+----------------+

|

||||

| Variable_name | Value |

|

||||

+-----------------------+----------------+

|

||||

| transaction_isolation | READ-COMMITTED |

|

||||

+-----------------------+----------------+

|

||||

```

|

||||

|

||||

关系型数据库的事务是一个很大的话题,因为当存在多个并发事务访问数据时,就有可能出现三类读数据的问题(脏读、不可重复读、幻读)和两类更新数据的问题(第一类丢失更新、第二类丢失更新)。想了解这五类问题的,可以阅读我发布在 CSDN 网站上的[《Java面试题全集(上)》](https://blog.csdn.net/jackfrued/article/details/44921941)一文的第80题。为了避免这些问题,关系型数据库底层是有对应的锁机制的,按锁定对象不同可以分为表级锁和行级锁,按并发事务锁定关系可以分为共享锁和独占锁。然而直接使用锁是非常麻烦的,为此数据库为用户提供了自动锁机制,只要用户指定适当的事务隔离级别,数据库就会通过分析 SQL 语句,然后为事务访问的资源加上合适的锁。此外,数据库还会维护这些锁通过各种手段提高系统的性能,这些对用户来说都是透明的。想了解 MySQL 事务和锁的细节知识,推荐大家阅读进阶读物[《高性能MySQL》](https://item.jd.com/11220393.html),这也是数据库方面的经典书籍。

|

||||

|

||||

ANSI/ISO SQL 92标准定义了4个等级的事务隔离级别,如下表所示。需要说明的是,事务隔离级别和数据访问的并发性是对立的,事务隔离级别越高并发性就越差。所以要根据具体的应用来确定到底使用哪种事务隔离级别,这个地方没有万能的原则。

|

||||

|

||||

<img src="https://gitee.com/jackfrued/mypic/raw/master/20211121225327.png" style="zoom:50%;">

|

||||

|

||||

### 总结

|

||||

|

||||

关于 SQL 和 MySQL 的知识肯定远远不止上面列出的这些,比如 SQL 本身的优化、MySQL 性能调优、MySQL 运维相关工具、MySQL 数据的备份和恢复、监控 MySQL 服务、部署高可用架构等,这一系列的问题在这里都没有办法逐一展开来讨论,那就留到有需要的时候再进行讲解吧,各位读者也可以自行探索。

|

||||

|

|

@ -0,0 +1,295 @@

|

|||

## Python程序接入MySQL数据库

|

||||

|

||||

在 Python3 中,我们可以使用`mysqlclient`或者`pymysql`三方库来接入 MySQL 数据库并实现数据持久化操作。二者的用法完全相同,只是导入的模块名不一样。我们推荐大家使用纯 Python 的三方库`pymysql`,因为它更容易安装成功。下面我们仍然以之前创建的名为`hrs`的数据库为例,为大家演示如何通过 Python 程序操作 MySQL 数据库实现数据持久化操作。

|

||||

|

||||

### 建库建表

|

||||

|

||||

```SQL

|

||||

-- 创建名为hrs的数据库并指定默认的字符集

|

||||

create database `hrs` default character set utf8mb4;

|

||||

|

||||

-- 切换到hrs数据库

|

||||

use `hrs`;

|

||||

|

||||

-- 创建部门表

|

||||

create table `tb_dept`

|

||||

(

|

||||

`dno` int not null comment '编号',

|

||||

`dname` varchar(10) not null comment '名称',

|

||||

`dloc` varchar(20) not null comment '所在地',

|

||||

primary key (`dno`)

|

||||

);

|

||||

|

||||

-- 插入4个部门

|

||||

insert into `tb_dept` values

|

||||

(10, '会计部', '北京'),

|

||||

(20, '研发部', '成都'),

|

||||

(30, '销售部', '重庆'),

|

||||

(40, '运维部', '深圳');

|

||||

|

||||

-- 创建员工表

|

||||

create table `tb_emp`

|

||||

(

|

||||

`eno` int not null comment '员工编号',

|

||||

`ename` varchar(20) not null comment '员工姓名',

|

||||

`job` varchar(20) not null comment '员工职位',

|

||||

`mgr` int comment '主管编号',

|

||||

`sal` int not null comment '员工月薪',

|

||||

`comm` int comment '每月补贴',

|

||||

`dno` int not null comment '所在部门编号',

|

||||

primary key (`eno`),

|

||||

constraint `fk_emp_mgr` foreign key (`mgr`) references tb_emp (`eno`),

|

||||

constraint `fk_emp_dno` foreign key (`dno`) references tb_dept (`dno`)

|

||||

);

|

||||

|

||||

-- 插入14个员工

|

||||

insert into `tb_emp` values

|

||||

(7800, '张三丰', '总裁', null, 9000, 1200, 20),

|

||||

(2056, '乔峰', '分析师', 7800, 5000, 1500, 20),

|

||||

(3088, '李莫愁', '设计师', 2056, 3500, 800, 20),

|

||||

(3211, '张无忌', '程序员', 2056, 3200, null, 20),

|

||||

(3233, '丘处机', '程序员', 2056, 3400, null, 20),

|

||||

(3251, '张翠山', '程序员', 2056, 4000, null, 20),

|

||||

(5566, '宋远桥', '会计师', 7800, 4000, 1000, 10),

|

||||

(5234, '郭靖', '出纳', 5566, 2000, null, 10),

|

||||

(3344, '黄蓉', '销售主管', 7800, 3000, 800, 30),

|

||||

(1359, '胡一刀', '销售员', 3344, 1800, 200, 30),

|

||||

(4466, '苗人凤', '销售员', 3344, 2500, null, 30),

|

||||

(3244, '欧阳锋', '程序员', 3088, 3200, null, 20),

|

||||

(3577, '杨过', '会计', 5566, 2200, null, 10),

|

||||

(3588, '朱九真', '会计', 5566, 2500, null, 10);

|

||||

```

|

||||

|

||||

### 接入MySQL

|

||||

|

||||

首先,我们可以在命令行或者 PyCharm 的终端中通过下面的命令安装`pymysql`,如果需要接入 MySQL 8,还需要安装一个名为`cryptography`的三方库来支持 MySQL 8 的密码认证方式。

|

||||

|

||||

```Shell

|

||||

pip install pymysql cryptography

|

||||

```

|

||||

|

||||

使用`pymysql`操作 MySQL 的步骤如下所示:

|

||||

|

||||